数据增强意义有哪些

数据增强的意义在于通过对有限原始数据进行合理变换与扩展,提升数据多样性和信息密度,从而显著增强模型的泛化能力、鲁棒性与实际应用稳定性。它能够在不增加高昂数据采集成本的前提下,缓解过拟合、应对类别不平衡,并帮助模型更好适应真实世界中的不确定性。无论从理论研究还是工程实践角度看,数据增强都已成为数据驱动系统中不可或缺的基础方法,其价值正随着应用复杂度的提升而持续放大。

Elara

Elara- 2026-04-03

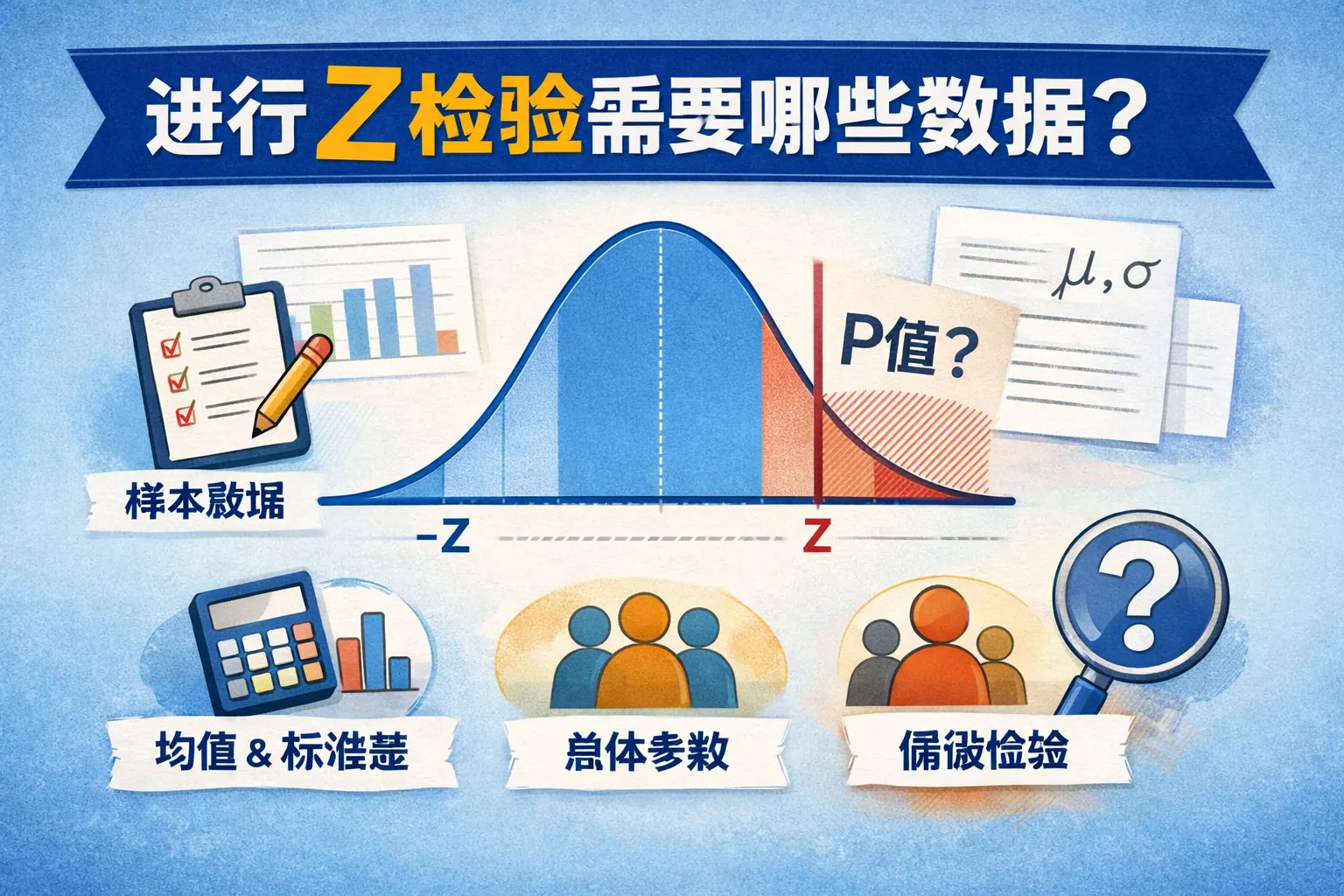

z 检验需要哪些数据

Z检验所需的数据核心包括样本观测值、样本容量、已知或可合理假定已知的总体标准差或总体比例,以及明确的原假设与显著性水平。根据检验对象不同,均值Z检验侧重样本均值与总体标准差,比例Z检验则依赖样本总量与事件次数。只有在样本量足够大、数据随机独立且总体参数条件满足时,Z检验的统计推断才具有可靠性,否则应考虑替代方法。

Rhett Bai

Rhett Bai- 2026-04-03

统计增速数据有哪些

统计增速数据是用于衡量指标变化速度的核心统计工具,广泛应用于宏观分析、行业研究和企业决策。常见的统计增速数据可按时间维度划分为同比、环比和定基增速,按计算方法分为名义增速和实际增速,按统计对象分为宏观、中观和微观增速,并可进一步区分规模型、效率型和结构型增速。不同类型的统计增速数据各有适用场景,需结合基数、口径和背景综合解读。未来,统计增速数据将更加注重质量、结构和高频化应用,以提升分析与决策的科学性。

Joshua Lee

Joshua Lee- 2026-04-03

统计数据不包括哪些数据

统计数据并不等同于所有可见的数据集合,它有清晰的边界与筛选原则。未经标准化处理的原始信息、缺乏明确统计口径的数据、无法验证来源的数字、纯主观判断以及重复或失真的异常记录,通常不包括在统计数据之内。统计数据强调可比性、可靠性与总体意义,其形成过程需要统一指标、质量控制和方法透明。只有理解哪些内容被排除在统计体系之外,才能避免误读统计结论,并在分析与决策中合理使用统计数据。

William Gu

William Gu- 2026-04-03

基尼数据需要哪些原始数据

基尼系数并非凭空产生,其计算依赖于一整套微观层面的原始数据。最核心的数据是可排序的个体或家庭收入、财富数值,同时还需要统计单位信息、样本权重、时间与区域变量以及用于数据清洗的辅助信息。只有在数据口径清晰、结构完整、质量可靠的前提下,基尼数据才能真实反映不平等状况。理解基尼数据所需的原始数据,有助于正确解读相关结论并避免误判。

Joshua Lee

Joshua Lee- 2026-04-03

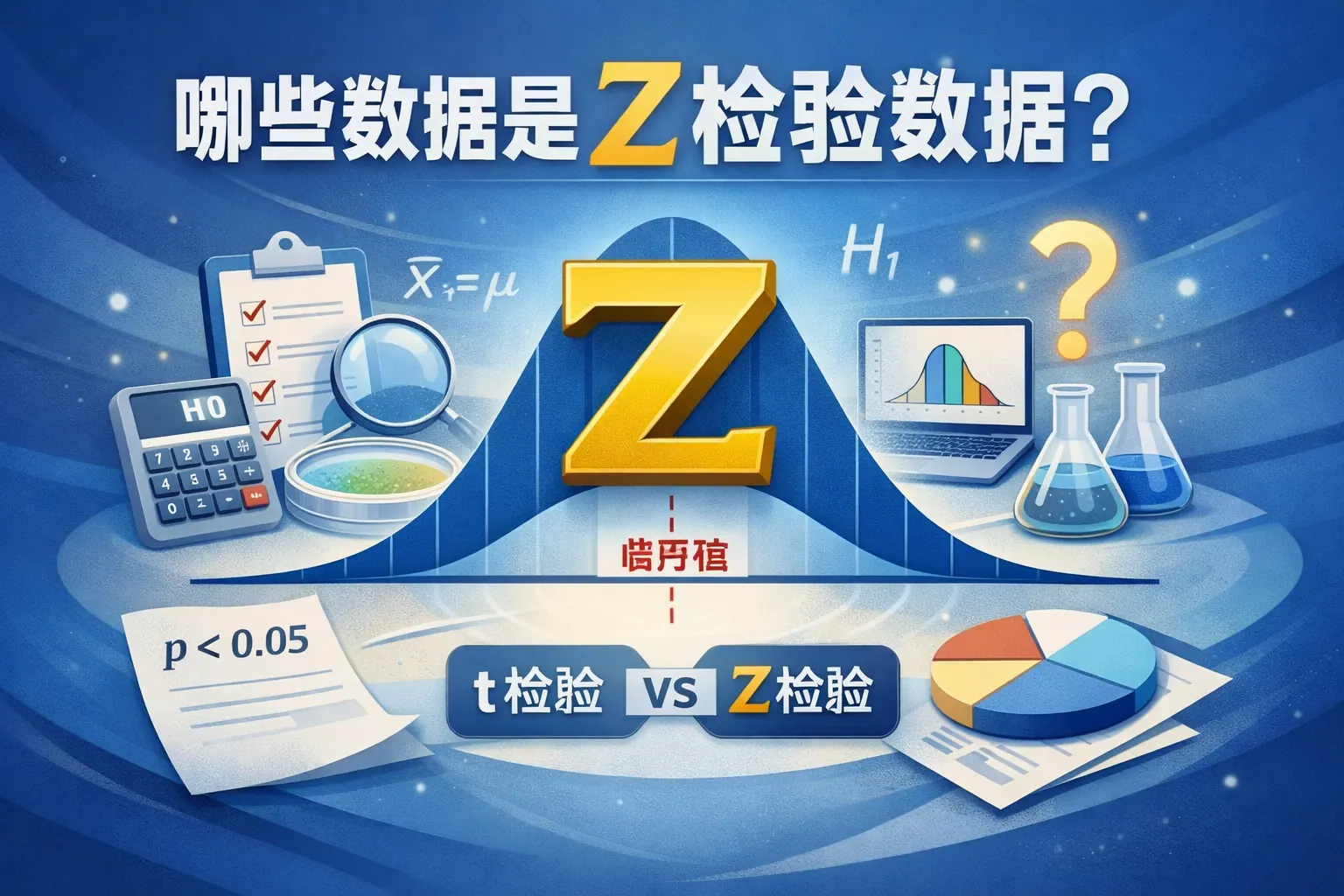

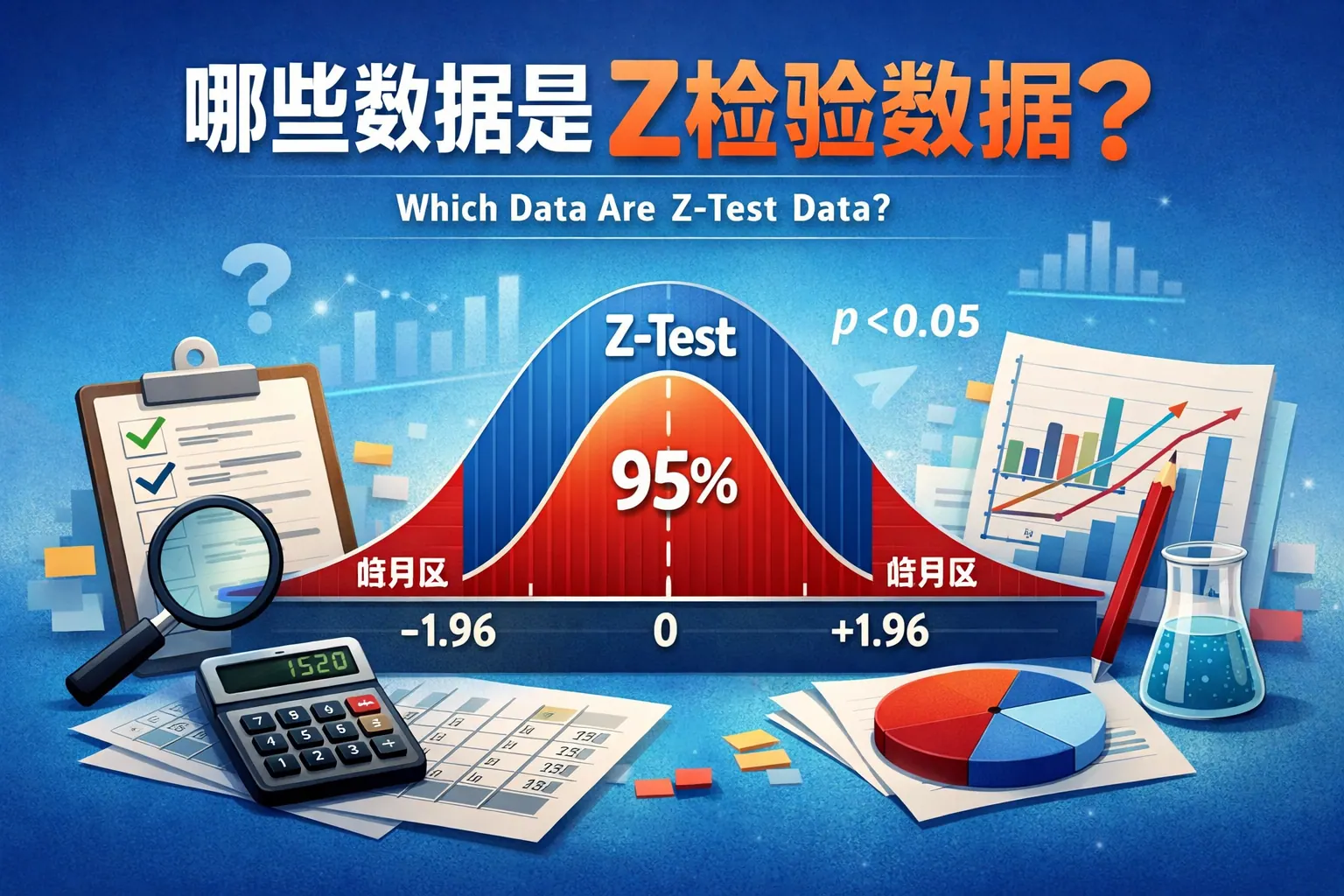

哪些数据是z检验数据的

Z检验适用于样本量较大、数据为连续型或比例型、且总体方差已知或可稳定估计的统计场景。只要满足正态近似和大样本条件,就可以使用Z检验进行均值或比例的假设检验;若样本量较小或总体方差未知,则更适合使用t检验。理解数据类型、样本规模与分布前提,是判断是否属于Z检验数据的关键。

William Gu

William Gu- 2026-04-03

哪些数据是z检验数据

z检验数据主要包括大样本定量数据、已知总体方差的数据以及满足正态近似条件的比例数据。当数据能够计算均值或比例,样本量通常达到30以上,或总体方差已知时,就可以使用z检验。相比t检验,z检验更适用于大规模调查与比例分析场景。在实际应用中,应结合数据类型、样本规模与分布特征综合判断是否属于z检验数据。

Rhett Bai

Rhett Bai- 2026-04-03

常见的数据分析法有哪些

常见的数据分析法包括描述性分析、对比分析、趋势分析、结构分析、相关与回归分析、假设检验、聚类分析和预测分析等,这些方法分别解决现状描述、差异识别、关系建模和未来预测等问题。不同分析方法复杂度与应用场景不同,企业应根据具体业务目标选择合适的数据分析方式,并逐步建立系统化的数据分析能力,以提升决策科学性和竞争优势。

William Gu

William Gu- 2026-04-03

列举数据分析法有哪些

数据分析法包括描述分析、对比分析、趋势分析、结构分析、相关分析、回归分析、聚类分析与预测分析等类型,分别用于解释现状、比较差异、识别趋势、分析结构、研究关系与预测未来。不同数据分析方法适用于不同业务场景,从基础统计到高级建模构成完整分析体系。企业通过科学选择与组合应用数据分析方法,能够提升决策质量与运营效率。未来数据分析将更加智能化与实时化,成为组织核心能力的重要组成部分。

William Gu

William Gu- 2026-04-03

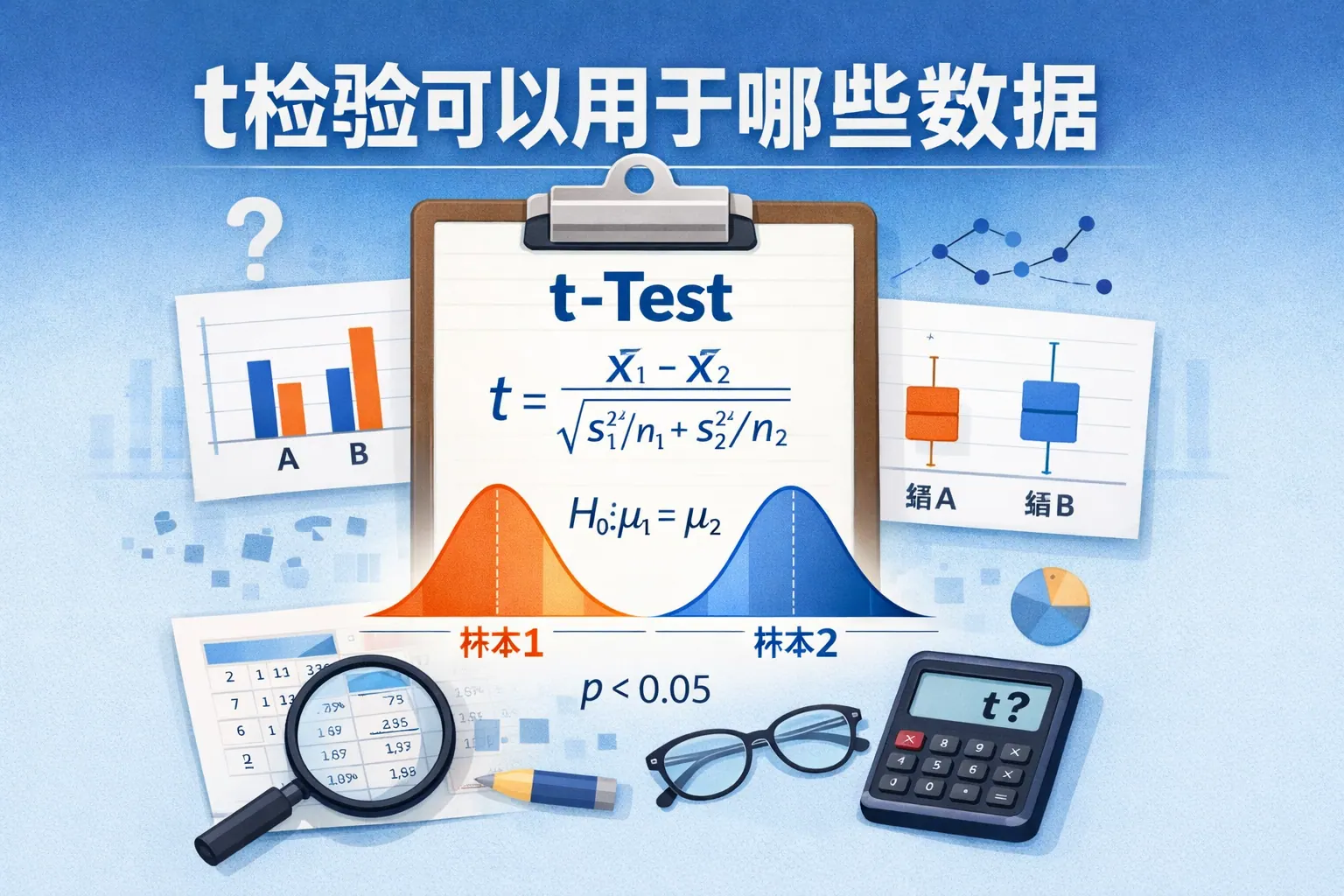

t检验可以用于哪些数据

t检验适用于连续型数值数据,主要用于比较均值是否存在显著差异,包括单样本、独立样本和配对样本三种形式。其前提是数据近似正态分布、样本量适中且总体标准差未知。分类变量、严重偏态数据或多组比较场景不适合直接使用t检验。正确理解数据类型与样本结构,是科学运用t检验进行统计推断的关键。

Joshua Lee

Joshua Lee- 2026-04-03

数据分析有哪些常用方法

数据分析常用方法主要包括描述分析、诊断分析、预测分析和规范分析四大类型,并延伸出统计分析、回归分析、时间序列、聚类与因果分析等具体技术。不同方法对应不同业务问题,从解释现象到预测趋势再到优化决策形成完整闭环。企业应根据业务目标与数据条件选择合适方法,并逐步构建系统化的数据分析能力体系。随着智能化与自动化发展,数据分析将更加实时化与决策导向化。

William Gu

William Gu- 2026-04-03

数据分析基本方法有哪些

数据分析的基本方法包括描述性分析、诊断性分析、预测性分析与决策优化分析,分别用于回答“发生了什么”“为什么发生”“未来会怎样”以及“应该怎么做”。这些方法以统计分析和建模技术为支撑,形成从数据整理到决策支持的完整体系。企业应根据业务阶段逐步提升分析能力,并避免常见误区,才能真正实现数据驱动决策与持续优化。

Joshua Lee

Joshua Lee- 2026-04-03

对数据有哪些分析方法

数据分析方法主要包括描述性分析、诊断性分析、预测性分析和规范性分析四大类别,并涵盖统计分析、回归分析、聚类分析、时间序列分析等具体技术路径。不同方法解决不同层级的问题,从解释现状到预测未来再到优化决策,构成完整的数据分析体系。企业应根据业务目标、数据条件与能力基础选择合适的方法,并逐步构建从基础统计到智能决策的系统化分析能力,以提升决策质量和竞争优势。

Joshua Lee

Joshua Lee- 2026-04-03

数据分析有哪些方法

数据分析方法主要包括描述性分析、诊断性分析、预测性分析和决策性分析四大类,分别用于回答发生了什么、为什么发生、将会发生什么以及应该怎么做。常见技术涵盖统计分析、回归分析、时间序列分析、聚类分析和优化模型等。企业通常从基础报表分析起步,逐步升级到预测与决策分析,构建完整的数据驱动体系。未来数据分析将更加智能化、实时化,并在战略决策中发挥更核心的作用。

Elara

Elara- 2026-04-03

工作任务比重怎么计算

文章系统阐释了任务比重的计算框架与落地路径:以“工作量+价值”为起点,逐步加入复杂度、风险、时效与依赖,通过加权评分与归一化得到百分比,再映射到人力与排期,配合数据治理与迭代复盘实现持续校准;在工具层面可用协作平台配置多维字段与报表,研发场景可借助PingCode打通流水线数据,通用协作可用Worktile承载治理,实现优先级、资源分配与绩效评估的统一。

Elara

Elara- 2025-12-23

团队如何假设

团队假设通过目标澄清、数据收集、成员分析和资源整合等流程,帮助企业预判团队未来表现、优化协作结构并提升资源配置效率。科学制定和验证团队假设能够降低风险、强化沟通并提升项目执行力。结合数据驱动方法与专业协作工具(如PingCode和Worktile),可持续优化团队假设,增强敏捷性和创新力。当前常见误区如经验化判断和假设僵化需予以规避,未来趋势将聚焦智能化、自适应团队配置及高效协作平台整合。

William Gu

William Gu- 2025-12-08